Meta met à jour ses étiquettes de contenu d'IA pour garantir qu'un plus large éventail de contenus synthétiques soit étiqueté, en réponse à un flot croissant de publications d'IA génératives dans l'application.

Au cours des derniers mois, de plus en plus d’appâts d’engagement IA sont apparus sur Facebook et ont également généré beaucoup d’engagement.

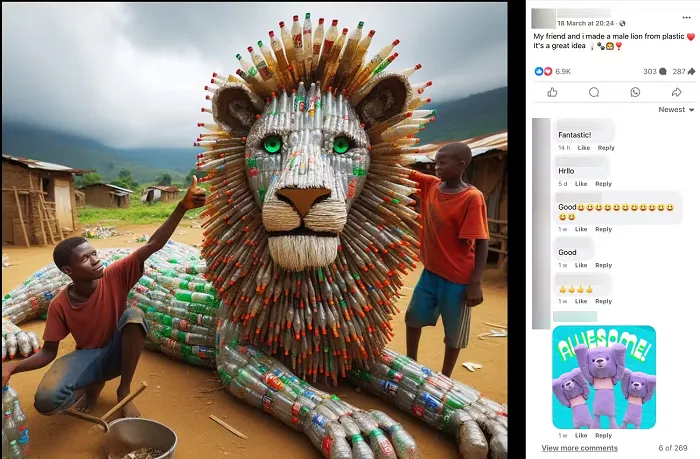

Par exemple, même le moindre examen minutieux révélerait qu’il ne s’agit pas d’une image réelle. Mais Facebook est utilisé par des milliards de personnes, et toutes ne vont pas zoomer, ni même avoir les connaissances numériques nécessaires pour savoir que l'IA générative peut même être utilisée de cette manière (comme l'indiquent les 6,9 000 J'aime sur cet article). ).

En tant que tel, Meta met à jour ses politiques d'étiquetage de l'IA pour garantir qu'un plus grand nombre de contenus générés par l'IA soient étiquetés et divulgués en conséquence.

Selon Meta :

« Notre approche actuelle est trop étroite, car elle ne couvre que les vidéos créées ou modifiées par l'IA pour donner l'impression qu'une personne dit quelque chose qu'elle n'a pas dit. Notre politique relative aux médias manipulés a été rédigée en 2020, à une époque où les contenus réalistes générés par l’IA étaient rares et où la préoccupation majeure concernait les vidéos. Au cours des quatre dernières années, et particulièrement l’année dernière, les gens ont développé d’autres types de contenus réalistes générés par l’IA, comme l’audio et les photos, et cette technologie évolue rapidement.

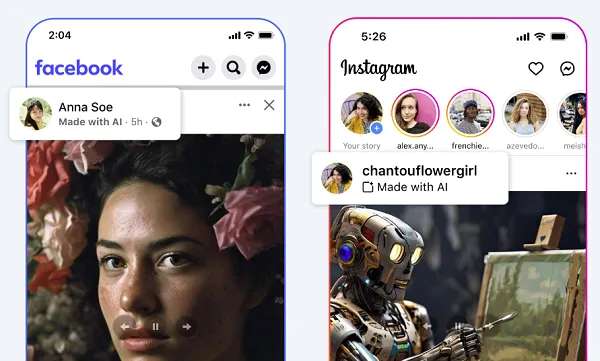

Le nouveau processus verra davantage d'étiquettes « Fabriqué avec l'IA » ajoutées aux contenu lorsque Meta détecte « des indicateurs d’image d’IA conformes aux normes de l’industrie ou lorsque des personnes révèlent qu’elles téléchargent du contenu généré par l’IA ».

Meta indique qu'elle laissera également davantage de contenu génératif d'IA dans ses applications, au lieu de le supprimer, les étiquettes ayant un objectif à la fois informatif et éducatif.

« Si nous déterminons que les images, vidéos ou fichiers audio créés ou modifiés numériquement présentent un risque particulièrement élevé de tromperie matérielle du public sur une question importante, nous pouvons ajouter une étiquette plus visible afin que les gens aient plus d'informations et de contexte. Cette approche globale donne aux gens plus d’informations sur le contenu afin qu’ils puissent mieux l’évaluer et ainsi avoir un contexte s’ils voient le même contenu ailleurs.

En d’autres termes, les étiquettes informeront immédiatement l’utilisateur que le contenu est faux, tout en montrant ce qui peut désormais être fait avec l’IA, ce qui contribuera à accroître la sensibilisation à ce sujet.

C'est une bonne mise à jour, même si beaucoup dépend ici de la capacité de Meta à détecter l'IA générative dans les publications.

Comme indiqué, dans l'exemple ci-dessus (et dans bien d'autres similaires), il est très évident pour la plupart qu'il a été généré par l'IA. Mais à mesure que les systèmes d’IA s’améliorent et que les gens apprennent de nouvelles façons de les utiliser, ceux-ci deviendront également plus difficiles à détecter, ce qui pourrait limiter la capacité automatisée de Meta à les détecter.

Mais là encore, la nouvelle approche donnera également aux modérateurs de Meta davantage de pouvoirs d'application sur ce sujet, et elle pourrait très bien servir un objectif important en sensibilisant à ce qui peut être fait avec les contrefaçons d'IA.

Le temps nous le dira, mais cela semble être une bonne mise à jour, qui pourrait avoir un impact sur l’expansion de l’utilisation de l’IA.

Meta indique qu'elle mettra en œuvre son nouveau processus d'étiquetage de l'IA en mai.