LinkedIn est la dernière plateforme sociale à ajouter des étiquettes au contenu généré par l'IA, via un partenariat avec la Coalition for Content Provenance and Authenticity (C2PA), qui utilise le marquage des données pour identifier les images de l'IA.

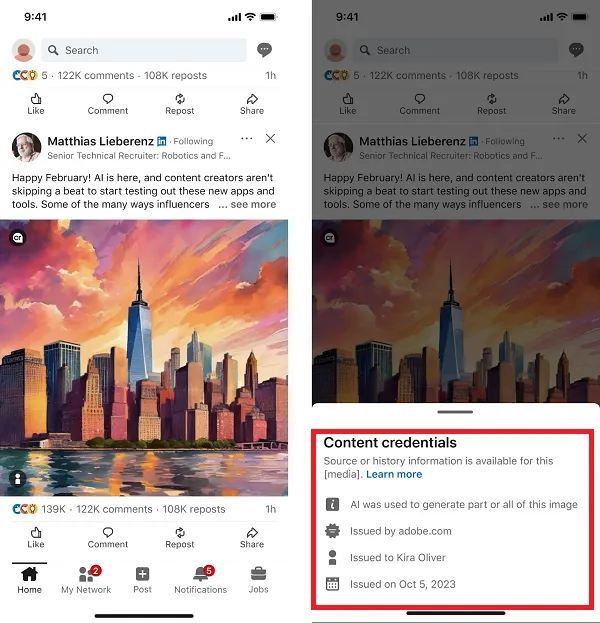

Comme vous pouvez le voir dans cet exemple (publié par un expert en marketing d'influence Lia Haberman), les images générées par l'IA et publiées sur LinkedIn incluront désormais une petite balise C2PA en haut à droite du visuel InStream. Appuyez sur cette icône et vous pourrez voir plus d'informations sur l'image.

Les balises seront automatiquement ajoutées, en fonction des données de code intégrées dans l'image, telles qu'identifiées par le processus C2PA.

C2PA est l'une des nombreuses organisations qui travaillent à établir des normes industrielles pour le contenu généré par l'IA, qui inclut des filigranes numériques qui ne peuvent pas être facilement supprimés du code back-end des images et des vidéos.

La société mère de LinkedIn, Microsoft, a déjà adhéré aux normes C2PA, aux côtés de Google, Adobe et OpenAI. C2PA a également été adopté par TikTok pour son processus de marquage de l'IA, annoncé plus tôt ce mois-ci.

La plupart des plateformes sociales intègrent désormais au moins une certaine forme de balises de contenu IA, ce qui contribuera à améliorer la transparence et à limiter la propagation de contenus « deepfakes » et/ou de représentations de choses qui ne sont pas réelles.

Ce qui est important, car si la plupart de ces représentations sont généralement inoffensives, même si elles soulèvent des questions sur leur authenticité (comme Le Pape dans une doudoune), d’autres utilisations abusives pourraient avoir un impact plus important. Comme de fausses images d’une attaque contre le Pentagone, ou de fausses représentations sur la guerre Israël-Hamas.

Ces types de générations d’IA peuvent influencer l’opinion publique, ce qui constitue un risque important à l’heure où nous nous dirigeons vers une série d’élections à travers le monde.

Et il existe une possibilité significative que le contenu généré par l’IA joue un rôle dans les prochaines élections américaines. Et souvent, même s’il est étiqueté comme faux, les balises sont ajoutées trop tard, les visuels ayant déjà un impact.

C'est pourquoi une détection automatisée et immédiate est importante, garantissant que ces étiquettes peuvent être apposées avant qu'elles ne puissent gagner du terrain.

La prochaine étape consiste donc à s’assurer que le public comprend la signification de ces étiquettes, mais l’uniformisation des rapports est le premier objectif à atteindre.