Comme beaucoup, y compris moi-même, l’ont remarqué à plusieurs reprises au fil des ans, Twitter a un problème avec les profils de robots.

Pendant des années, les utilisateurs se sont plaints de l’impact des bots et des faux comptes sur la plate-forme, et alors que divers rapports de recherche ont indexé les faux niveaux de profil de Twitter entre 5% et 15%, leur présence est apparemment encore plus significative que cela. Les chercheurs ont à plusieurs reprises pointu à des essaims massifs de comptes de robots utilisés à des fins malveillantes, l’utilisation la plus préoccupante étant l’amplification de messages politiques, afin de noyer les points de vue opposés.

Mais Twitter maintenant dit que beaucoup de ces statistiques sont incorrectes – et non seulement elles sont incorrectes, mais elles sont aussi, potentiellement, dangereuses pour le discours public.

Twitter dit qu’il a amélioré ses systèmes de détection et de suppression des profils de robots problématiques au fil du temps, et l’insinuation de ces rapports – que Twitter permet un retweet en masse à une échelle telle qu’elle influence l’opinion publique – est erronée.

Dans un Publier co-rédigés par Yoel Roth, responsable de l’intégrité de Twitter, et Nick Pickles, directeur de la stratégie de politique publique mondiale de la société, ils décrivent les différentes limites de l’analyse de bot Twitter tiers et indiquent leurs propres résultats comme un indicateur plus précis de performance.

Selon le Publier:

« Il y a quelques années, les comptes automatisés étaient un problème pour nous. Nous nous sommes concentrés dessus, avons fait des investissements et avons constaté des gains significatifs en les abordant sur toutes les surfaces de Twitter. »

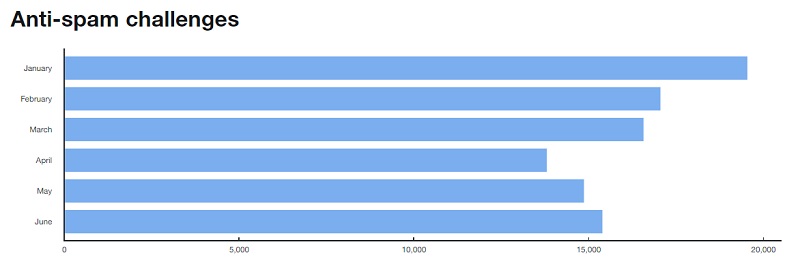

Twitter affirme que son rapport de transparence est un bon indicateur de ses progrès à cet égard – dans sa mise à jour la plus récente, Twitter dit que son nombre total de Les défis lancés à des comptes de spam présumés – qui incluent des bots malveillants – étaient de 15,4 millions, couvrant juin 2019.

En utilisant cela comme indicateur, Twitter comptait 139 millions de mDAU à ce moment-là – donc sur cette base, à titre de mesure très approximative, le nombre total de faux profils possibles détectés au cours de cette période n’aurait pu s’élever qu’à 11,08%. Mais ce chiffre comprend également toutes les autres violations possibles, ce qui suggérerait que le chiffre réel du compte de spam de Twitter, basé sur ses propres actions entreprises, se situe dans les bas chiffres simples – et ils sont en effet à la fois détectés et supprimés systématiquement.

Étant donné que ce nombre s’améliore également avec le temps (comme le montre le graphique), Twitter dit qu’il se débarrasse principalement des robots trompeurs. Ce qui conduit à une autre distinction clé que Twitter souhaite faire.

« Il est important de noter que toutes les formes d’automatisation ne sont pas nécessairement des violations des règles Twitter. Nous avons vu des utilisations innovantes et créatives de l’automatisation pour enrichir l’expérience Twitter – par exemple, des comptes comme @pentametron et @tinycarebot. »

Twitter note également que les profils d’entreprise peuvent également utiliser des bots et l’automatisation pour améliorer les interactions avec le service client.Vous ne pouvez donc pas qualifier tous les robots de mauvais, ce qui obscurcit davantage les chiffres.

Alors, quels robots Twitter considère-t-il comme enfreignant ses règles?

Twitter présente différents types d’utilisation abusive qui entraîneront l’interdiction d’un profil de bot.

- Utilisation malveillante de l’automatisation pour saper et perturber la conversation publique, comme essayer de mettre quelque chose à la mode

- Amplification artificielle des conversations sur Twitter, y compris par la création de comptes multiples ou qui se chevauchent

- Générer, solliciter ou acheter de faux engagements

- S’engager dans des tweets en masse ou agressifs, engager ou suivre

- Utiliser des hashtags de manière spammée, y compris en utilisant des hashtags non liés dans un tweet (également appelé «hashtag cramming»)

Ainsi, l’objectif principal de la critique des bots – manipuler la conversation – est en effet une violation, et Twitter supprimera les bots qui enfreignent cette règle. Tant qu’il les détecte, ce qu’il dit, pour la plupart, il le fait.

«Notre puissance technologique pour identifier et supprimer de manière proactive ces comportements sur l’ensemble de notre service est plus sophistiquée que jamais. Nous suspendons définitivement des millions de comptes chaque mois qui sont automatisés ou contenant du spam, et nous le faisons avant même qu’ils n’atteignent un globe oculaire dans une chronologie ou une recherche Twitter. . «

Twitter supprime donc les bots et ses processus de détection avancés suggèrent que le problème n’est pas aussi prononcé que certains rapports le suggèrent.

Que cela vous paraisse vrai ou non est en grande partie une question d’opinion. Ou les données fournies dans les études universitaires sur les tweets incriminés.

C’est là qu’il devient plus difficile de prendre le contre-argument de Twitter – les études auxquelles ils font référence ont en fait les tweets comme données, elles montrent que les tweets sont souvent répétés, mot pour mot, et republiés en succession rapide au milieu de périodes de discussion tendance. . Nous savons que cela se produit – mais selon Twitter, c’est soit en fait tweeté par de vraies personnes, soit c’est une mauvaise interprétation de la tendance plus large.

Twitter note spécifiquement que des outils tels que Botometer et Bot Sentinel, qui visent à identifier l’activité des robots en fonction d’une gamme de paramètres, ne sont généralement pas précis.

« Ces outils commencent par un humain qui regarde un compte – en utilisant souvent les mêmes informations de compte public que vous pouvez voir sur Twitter – et identifie les caractéristiques qui en font un bot. Donc, en substance, le nom du compte, le niveau de Tweeting, l’emplacement dans la bio, les hashtags utilisés, etc. C’est une approche extrêmement limitée. «

Encore une fois, Twitter affirme que ses propres systèmes de détection sont maintenant beaucoup plus développés que ces outils ne le permettent, et qu’en tant que tels, les chiffres indiqués par ces outils sont non seulement faux, mais peuvent être préjudiciables à la discussion connexe.

« Des jugements binaires sur qui est un » robot ou pas « , qui ont un réel potentiel d’empoisonner notre discours public – en particulier lorsqu’ils sont expulsés par les médias. »

En résumé, l’affirmation de Twitter selon laquelle les rapports indiquant une manipulation généralisée des bots – y compris ceux mentionnés ici, ici, ici et ici – sont probablement trompeurs sur l’impact réel d’une telle manipulation. Cela ne veut pas dire que Twitter a couvert tous les angles, ni qu’il est totalement exempt de manipulation de robots. Mais lorsque les gens exécutent un profil via un vérificateur de robots, ce n’est probablement pas assez de preuves pour pointer du doigt et accuser tout utilisateur de manipulation coordonnée.

Sur la base des données disponibles, cela pourrait être vrai, mais c’est très difficile à dire – car personne ne sait, avec certitude, combien de profils Twitter sont, en effet, des bots. Comme le dit Twitter, une grande partie de l’activité supposée des robots peut bien être de vraies personnes qui partagent simplement des messages similaires ou qui s’engagent fortement sur certains sujets. Certaines campagnes de robots suggérées pourraient également être étiquetées comme telles par des personnes qui ne veulent tout simplement pas accepter les résultats ou les tendances réels, de sorte qu’ils les rejettent comme artificielles.

Twitter est certainement le mieux placé pour comprendre cela, avec un accès aux données brutes, et selon Twitter, la plupart des activités des robots sont traitées. Il convient également de noter que Twitter envisage de nouvelles balises pour les comptes de bot, comme les ticks vérifiés pour les bots, ce qui pourrait aider à mieux comprendre les origines de tendances spécifiques.

Encore une fois, la façon dont vous prenez cela dépendra de votre sentiment personnel, mais les chiffres suggèrent que Twitter travaille pour résoudre son problème de bot – et que le problème lui-même n’est peut-être pas aussi prononcé qu’il y paraît.

MISE À JOUR (21/05): Christopher Bouzy, le créateur de Bot Sentinel, l’une des applications spécifiquement mentionnées dans le message de Twitter, a réfuté à la suggestion que le système utilisé par Bot Sentinel est inexact. Bouzy dit que c’est une insulte de suggérer que Bot Sentinel utilise une «méthodologie inférieure» et affirme que son processus est très précis pour détecter les comptes problématiques.

Selon Bouzy:

« Il y a déjà suffisamment de gens qui diffusent de la désinformation et de la désinformation sur cette plate-forme, nous ne voulons pas que les personnes qui représentent des sociétés cotées en bourse publient des informations inexactes et trompeuses qui peuvent être facilement réfutées par des données publiques facilement accessibles. »