La semaine dernière, Susan, PDG de YouTube Wojcicki a décrit les efforts continus de la plateforme pour répondre aux principaux sujets de préoccupation dans sa dernière mise à jour trimestrielle.

Parmi les notes de Wojcicki, elle a expliqué les lignes directrices des «quatre R» de la plateforme qui orientent ses processus à cet égard:

Cette semaine, YouTube a fourni une mise à jour spécifique sur le premier élément répertorié – la suppression du contenu inapproprié et la manière dont il travaille pour améliorer ses efforts sur ce front.

Selon YouTube:

« Nous supprimons les contenus préjudiciables depuis le lancement de YouTube, mais notre investissement dans ce travail s’est accéléré ces dernières années. En raison de ce travail en cours, au cours des 18 derniers mois, nous avons réduit le nombre de vues sur les vidéos qui sont ensuite supprimées pour avoir enfreint nos règles. de 80%, et nous travaillons continuellement à réduire encore ce nombre. «

C’est un résultat significatif – pour fournir plus de contexte, YouTube a également fourni cette visualisation de ses processus de suppression en évolution.

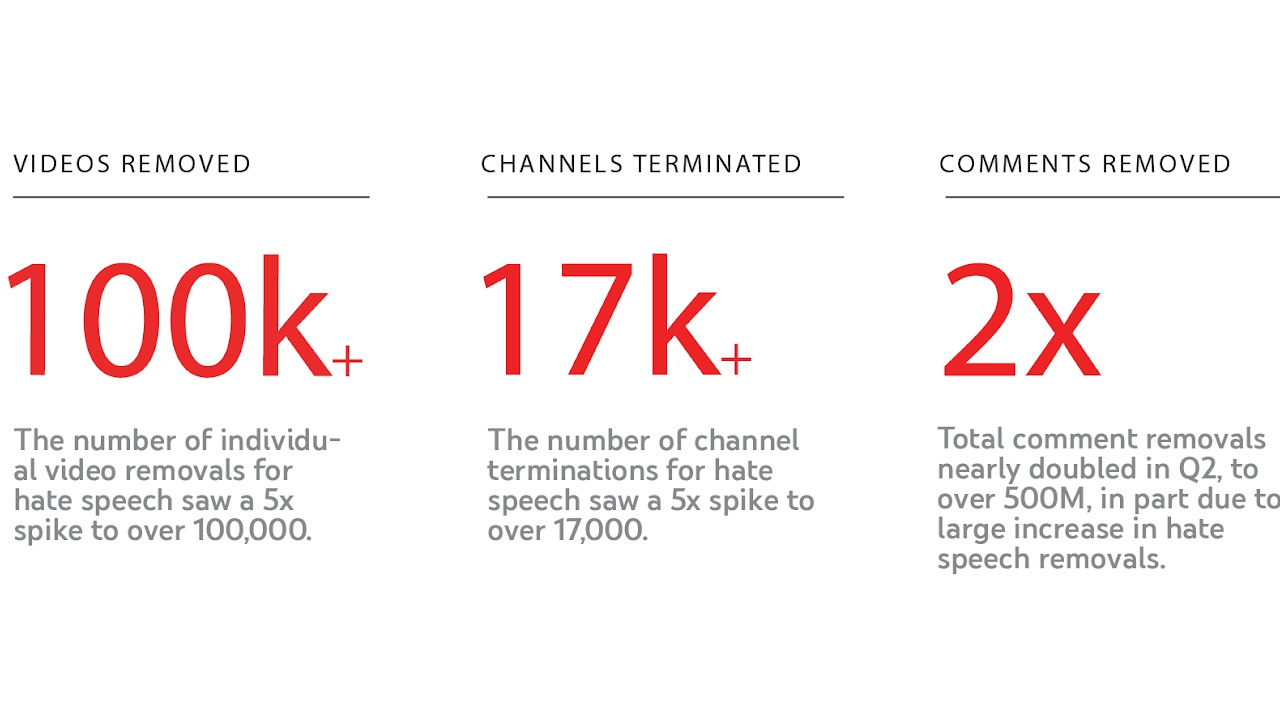

L’un des principaux sujets de préoccupation à cet égard est le discours de haine, et YouTube a également fait des progrès significatifs dans ce domaine.

« Nous avons passé des mois à développer soigneusement le [hate speech] politique et en travaillant avec nos équipes pour créer les formations et les outils nécessaires à son application. La politique a été lancée début juin et, à mesure que nos équipes examinent et suppriment davantage de contenu conformément à la nouvelle politique, notre détection des machines s’améliorera en parallèle. «

En effet, selon les statistiques de YouTube, sa politique en matière de discours de haine a entraîné la suppression de plus de 17 000 comptes.

Ce sont des chiffres significatifs, soulignant l’engagement continu de YouTube en faveur de la sécurité des utilisateurs et améliorant l’expérience des particuliers et des entreprises en ce qui concerne le placement d’annonces.

Entre autres statistiques clés:

- YouTube affirme que plus de 87% des 9 millions de vidéos supprimées au deuxième trimestre de 2019 ont été signalées pour la première fois par ses systèmes d’apprentissage automatique.

- Une mise à jour de ses systèmes de détection de spam au deuxième trimestre de 2019 a entraîné une augmentation de plus de 50% du nombre de canaux fermés pour violation de nos politiques anti-spam.

- Les près de 30 000 vidéos supprimées pour discours de haine au cours du dernier mois « n’ont généré que 3% des vues des vidéos de tricot sur la même période ».

YouTube a fait l’objet d’un examen plus minutieux ces derniers temps au milieu des craintes que les utilisateurs puissent tomber dans les terriers de la désinformation et se radicaliser en conséquence.

De retour en juin, Le New York Times a dressé le profil de l’utilisateur de YouTube Caleb Cain, qui avait été de plus en plus entraîné dans des complots d’extrême droite par les recommandations de contenu de YouTube.

Comme indiqué par NYT:

« Le fil conducteur de beaucoup de ces histoires est YouTube et son algorithme de recommandation, le logiciel qui détermine les vidéos qui apparaissent sur les pages d’accueil des utilisateurs et dans la barre latérale » Up Next « à côté d’une vidéo en cours de lecture. L’algorithme est responsable de plus plus de 70% de tout le temps passé sur le site. »

L’affaire met en évidence l’influence significative de YouTube, et l’influence de son algorithme en particulier, c’est pourquoi son travail pour améliorer ses processus à cet égard est si essentiel.

De toute évidence, sur la base de ces statistiques, YouTube prend ce défi au sérieux, et même s’il ne sera jamais en mesure d’éliminer totalement les éléments négatifs de l’infiltration de son site, les statistiques ici suggèrent qu’il s’améliore et s’efforce de limiter les abus.