Bien qu’il ne dirige peut-être pas encore la charge publique sur le front de l’IA générative, Meta développe une gamme d’options de création d’IA. Bien qu’il travaille sur ces options depuis des années, il cherche seulement maintenant à publier davantage de ses recherches pour la consommation publique.

Cela a été motivé par l’intérêt soudain pour les outils d’IA génératifs, mais encore une fois, Meta développe ces outils depuis un certain temps, même s’il semble quelque peu réactif avec son calendrier de lancement plus récent.

Le dernier article sur l’IA générative de Meta examine un nouveau processus qu’il appelle « Architecture prédictive d’intégration d’images‘ (I-JEPA), qui permet une modélisation visuelle prédictive, basée sur une compréhension plus large d’une image, par opposition à la correspondance des pixels.

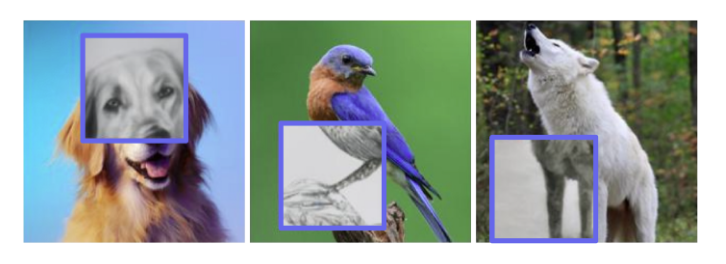

Les sections dans les cases bleues représentent ici les sorties du système I-JEPA, montrant comment il développe une meilleure compréhension contextuelle de ce à quoi les images devraient ressembler, sur la base d’entrées fractionnaires.

Ce qui est quelque peu similaire aux outils de « peinture » qui ont fait leur apparition dans d’autres outils d’IA générative, comme l’exemple ci-dessous de DALL-E, permettant aux utilisateurs de créer tous les nouveaux arrière-plans des visuels, en fonction des repères existants.

La différence dans l’approche de Meta est qu’elle est basée sur l’apprentissage automatique réel du contexte, qui est un processus plus avancé qui simule la pensée humaine, par opposition à l’appariement statistique.

Comme l’explique Meta :

« Notre travail sur I-JEPA (et plus généralement sur les modèles d’architecture prédictive d’intégration conjointe (JEPA)) est fondé sur le fait que les humains acquièrent une énorme quantité de connaissances de base sur le monde simplement en l’observant passivement. Il a été émis l’hypothèse que ces informations de bon sens sont essentielles pour permettre un comportement intelligent tel que l’acquisition efficace d’échantillons de nouveaux concepts, la mise à la terre et la planification.

Le travail ici, guidé par les recherches du scientifique en chef de l’IA de Meta Jann LeCunest une autre étape vers la simulation d’une réponse plus humaine dans les applications d’IA, qui est le véritable franchissement des frontières qui pourrait faire passer les outils d’IA à l’étape suivante.

Si les machines peuvent apprendre à penser, au lieu de simplement deviner sur la base de probabilités, cela verra l’IA générative prendre une vie propre. Ce qui effraie certaines personnes, mais cela pourrait conduire à de nouvelles utilisations pour de tels systèmes.

« L’idée derrière I-JEPA est de prédire les informations manquantes dans une représentation abstraite plus proche de la compréhension générale des gens. Par rapport aux méthodes génératives qui prédisent dans l’espace pixel/token, I-JEPA utilise des cibles de prédiction abstraites pour lesquelles les détails inutiles au niveau du pixel sont potentiellement éliminés, amenant ainsi le modèle à apprendre davantage de caractéristiques sémantiques.

Il s’agit du dernier-né des outils d’intelligence artificielle avancés de Meta, qui incluent désormais également la génération de texte, des outils d’édition visuelle, l’apprentissage multimodal, la génération de musique, etc. Tous ces éléments ne sont pas encore disponibles pour les utilisateurs, mais les diverses avancées mettent en évidence le travail en cours de Meta dans ce domaine, qui est devenu un objectif plus important alors que d’autres systèmes d’IA générative ont frappé le marché grand public.

Encore une fois, Meta peut sembler rattraper son retard, mais comme Google, il est en fait bien avancé sur ce front et bien placé pour déployer de nouveaux outils d’IA qui amélioreront ses systèmes au fil du temps.

Il s’agit simplement d’être plus prudent – ce qui, compte tenu des diverses préoccupations concernant les systèmes d’IA générative, ainsi que de la désinformation et des erreurs que ces outils propagent désormais en ligne, pourrait être une bonne chose.

Vous pouvez en savoir plus sur le projet I-JEPA de Meta ici.