Meta a publié un nouvel aperçu de ses efforts en constante évolution pour lutter contre les opérations d’influence coordonnées sur ses applications, qui sont devenues un élément clé de la plate-forme après l’élection présidentielle américaine de 2016, au cours de laquelle des agents basés en Russie ont utilisé Facebook pour influencer les électeurs américains. .

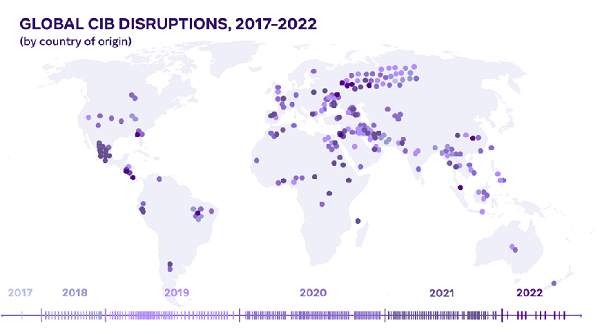

Depuis lors, Meta dit avoir détecté et supprimé plus de 200 opérations d’influence secrètes, tout en partageant des informations sur le comportement de chaque réseau avec d’autres acteurs de l’industrie, afin qu’ils puissent tous apprendre des mêmes données et développer de meilleures approches pour y faire face.

Selon Meta :

« Qu’ils viennent d’États-nations, d’entreprises commerciales ou de groupes non attribués, le partage de ces informations a permis à nos équipes, journalistes d’investigation, responsables gouvernementaux et pairs de l’industrie de mieux comprendre et exposer les risques de sécurité à l’échelle d’Internet, y compris avant des élections critiques.”

Meta indique qu’il a détecté des opérations d’influence ciblant plus de 100 pays différents, les États-Unis étant le pays le plus ciblé, suivis de l’Ukraine et du Royaume-Uni.

Cela indique probablement l’influence des États-Unis sur la politique mondiale, alors que cela pourrait également être lié à la popularité des réseaux sociaux dans ces régions, ce qui en fait un vecteur d’influence plus important.

En termes d’origine de ces groupes, la Russie, l’Iran et le Mexique ont été les trois sources géographiques les plus prolifiques de l’activité CIB.

La Russie, comme indiqué, est le pays le plus médiatisé pour de telles opérations – bien que Meta note également que si de nombreuses opérations russes ont ciblé les États-Unis, davantage d’opérations russes ont en fait ciblé l’Ukraine et l’Afrique, dans le cadre des efforts mondiaux de la nation pour influencer l’opinion publique et sentiments politiques.

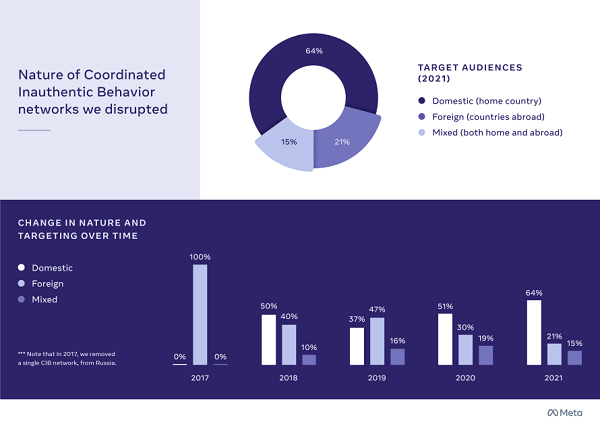

Meta note également qu’au fil du temps, de plus en plus de ces types d’opérations ont en fait ciblé leur propre pays, par opposition à une entité étrangère.

« Par exemple, nous avons signalé un certain nombre d’agences gouvernementales ciblant leur propre population en Malaisie, Nicaragua, Thaïlande et Ouganda. En fait, les deux tiers des opérations que nous avons interrompues depuis 2017 se concentraient entièrement ou partiellement sur les audiences nationales.”

En ce qui concerne l’évolution de ces opérations, Meta note que, de plus en plus, les groupes CIB se tournent vers des images générées par l’IA, par exemple, pour masquer leur activité.

« Depuis 2019, nous avons constaté une augmentation rapide du nombre de réseaux utilisant des photos de profil générées à l’aide de techniques d’intelligence artificielle telles que les réseaux antagonistes génératifs (GAN). Cette technologie est facilement disponible sur Internet, permettant à quiconque – y compris les acteurs de la menace – de créer une photo unique. Plus des deux tiers de tous les réseaux CIB que nous avons perturbés cette année présentaient des comptes qui avaient probablement des images de profil générées par le GAN, ce qui suggère que les acteurs de la menace pourraient y voir un moyen de rendre leurs faux comptes plus authentiques et originaux dans le but d’échapper détection par les enquêteurs open source, qui pourraient s’appuyer sur des recherches d’images inversées pour identifier les photos de profil des photos d’archives.

Ce qui est intéressant, en particulier si l’on considère l’augmentation constante de la technologie de génération d’IA, allant des images fixes à la vidéo en passant par le texte et plus encore. Bien que ces systèmes aient des utilisations précieuses, il existe également des dangers et des préjudices potentiels, et il est intéressant d’examiner comment ces technologies peuvent être utilisées pour masquer une activité inauthentique.

Le rapport fournit une perspective précieuse sur l’ampleur du problème et sur la manière dont Meta travaille pour lutter contre les tactiques en constante évolution des escrocs et des opérations de manipulation en ligne.

Et ils ne vont pas s’arrêter – c’est pourquoi Meta a également lancé un appel à une réglementation accrue, ainsi qu’à une action continue des groupes industriels.

Meta met également à jour ses propres politiques et processus en fonction de ces besoins, y compris les fonctionnalités de sécurité mises à jour et options d’assistance.

Qui comprendra également plus de capacité de chat en direct :

« Bien que nos outils de récupération de compte à l’échelle visent à résoudre la majorité des problèmes d’accès aux comptes, nous savons qu’il existe des groupes de personnes qui pourraient bénéficier d’une assistance supplémentaire, axée sur l’homme. Cette année, nous avons soigneusement développé un petit test d’une fonctionnalité d’assistance par chat en direct sur Facebook, et nous commençons à voir des résultats positifs. Par exemple, au cours du mois d’octobre, nous avons proposé notre option d’assistance par chat en direct à plus d’un million de personnes dans neuf pays, et nous prévoyons d’étendre ce test à plus de 30 pays à travers le monde.”

Cela pourrait être une grosse mise à jour, comme le savent tous ceux qui ont déjà eu affaire à Meta, mettre un humain en ligne pour l’aider peut être une tâche presque impossible.

Il est difficile de le faire évoluer, en particulier lorsqu’il dessert près de 3 milliards d’utilisateurs, mais Meta s’efforce désormais de fournir davantage de fonctionnalités d’assistance, comme un autre moyen de mieux protéger les personnes et de les aider à éviter les dommages en ligne.

C’est une bataille sans fin, et avec la capacité d’atteindre autant de personnes, vous pouvez vous attendre à voir de mauvais acteurs continuer à cibler les applications de Meta comme moyen de diffuser leurs messages.

En tant que tel, il convient de noter comment Meta affine son approche, tout en notant l’étendue des travaux menés jusqu’à présent sur ces éléments.

Vous pouvez lire l’intégralité de Meta Rapport coordonné sur la lutte contre les comportements inauthentiques pour 2022 ici.